Click to upload or drag and drop

Supported formats: MPEG, WAV, X-WAV, AAC, MP4, OGG Maximum file size: 200MB

URL of the audio file to transcribe

Language code of the audio

Tag audio events like laughter, applause, etc.

Whether to annotate who is speaking

A configurable parameter. Defaults to true in the Playground.

Complete guide to using

API de transcription audio en texte ElevenLabs

Transformez l’audio en texte précis avec l’API ElevenLabs Scribe. Prise en charge de 99 langues, diarisation des locuteurs, étiquetage des événements audio et tarification API accessible — le tout optimisé pour les développeurs.

API ElevenLabs Scribe v1 : transcrivez la parole en texte avec une précision exceptionnelle

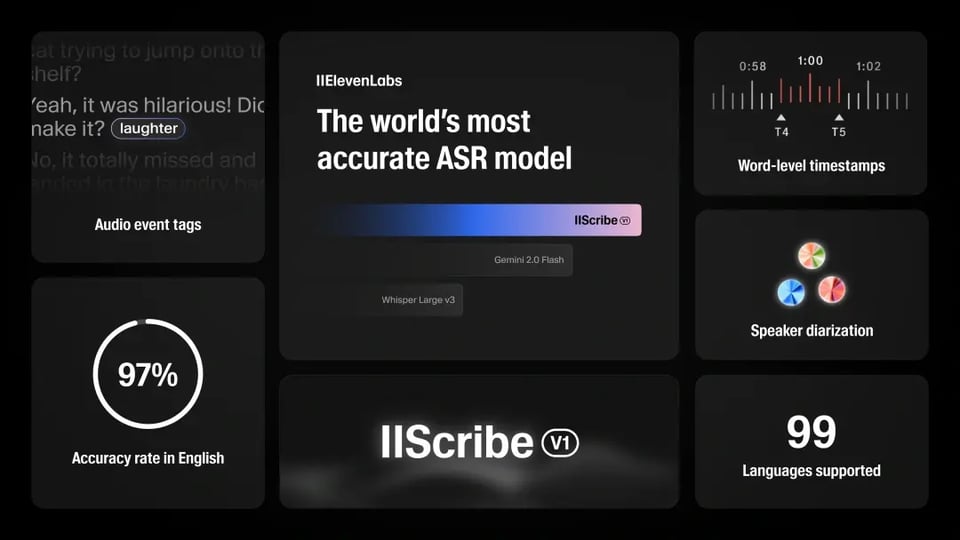

L’API speech to text ElevenLabs est conçue pour transformer l’audio parlé en texte clair et bien organisé avec une précision exceptionnelle. Propulsée par le modèle Scribe v1, elle gère les défis réels tels que le bruit de fond, les multiples intervenants et la variété des accents. Les développeurs peuvent facilement transcrire l’audio en texte dans 99 langues, ce qui en fait une solution polyvalente pour les applications, les médias et les flux de travail d’entreprise.

Fonctionnalités de pointe de l’API ElevenLabs Scribe v1

Support multilingue pour 99 langues

L'API de transcription de la parole en texte ElevenLabs offre une transcription automatique dans 99 langues, y compris des langues moins répandues comme le serbe et le malayalam. Que vous développiez des applications multilingues, transcriviez des appels professionnels internationaux ou créiez des sous-titres pour des médias mondiaux, le modèle Scribe ASR garantit des résultats précis à travers les accents et les dialectes, sans nécessiter de changement manuel entre les langues.

Précision inégalée

L'API de transcription de la parole en texte ElevenLabs atteint une précision inégalée, avec des taux d'erreur de mots aussi bas que 3,3 % en anglais et 1,3 % en italien, selon les normes FLEURS. Elle excelle dans des environnements bruyants et complexes, avec des accents variés et la parole spontanée, ce qui la rend idéale pour la transcription de podcasts, d'entretiens ou de réunions.

Horodatage au niveau des caractères pour une précision maximale

Ce que vous voyez est exactement ce que vous obtenez : aperçu en temps réel. Avec des horodatages au niveau des caractères, les développeurs peuvent repérer précisément le moment où chaque mot est prononcé. Cette fonctionnalité est essentielle pour les sous-titres, les sous-titres codés et les transcriptions synchronisées. En utilisant l'API ElevenLabs Scribe, vous pouvez transcrire l'audio en texte avec un alignement précis, offrant ainsi aux utilisateurs une expérience de lecture et de visionnage plus fluide.

Diarisation des locuteurs pour les audios avec plusieurs intervenants

L’API STT d’ElevenLabs identifie jusqu’à 32 locuteurs dans un même enregistrement, en étiquetant chacun avec une précision extrême. Cette fonctionnalité de speech-to-text est idéale pour transcrire des réunions ou des tables rondes, en assurant une attribution précise des locuteurs. Les développeurs peuvent tirer parti de la diarisation pour créer des transcriptions structurées et consultables, facilitant leur utilisation pour des projets collaborComparaison API STTatifs ou médiatiques.

Transcriptions enrichies grâce à l’étiquetage des événements audio

Au-delà des mots, l’API ElevenLabs Scribe étiquette les sons non verbaux tels que les rires ou les applaudissements, enrichissant la transcription. Cette fonctionnalité d’étiquetage des événements audio ajoute du contexte aux transcriptions, les rendant plus complètes. L’API speech-to-text fournit des sorties JSON structurées, facilitant l’intégration dans des processus créatifs.

API speech-to-text d’ElevenLabs vs autres modèles ASR

L’API speech-to-text d’ElevenLabs, avec le modèle Scribe v1, est à la pointe de la transcription audio-texte : elle offre une précision inégalée, prend en charge 99 langues et intègre des fonctionnalités avancées telles que la diarisation des locuteurs. Comparée à OpenAI Whisper, Google Cloud Speech-to-Text et AWS Transcribe, elle excelle dans des conditions audio réelles. OpenAI Whisper est abordable mais ne propose pas de diarisation native ; Google Cloud offre un streaming robuste, mais à un coût plus élevé ; AWS apporte de solides garanties de conformité, mais avec une précision multilingue moindre.

| Fonctionnalité | ElevenLabs Scribe v1 | OpenAI Whisper | Google Cloud STT | AWS Transcribe |

|---|---|---|---|---|

| WER (English) | 3.3% (FLEURS) | 7.7% (Indonesian) | Higher in accents | Higher in noise |

| Languages | 99, auto-detection | ~99, translation | 125+, ecosystem | 100+, streaming |

| Diarization | Up to 32 speakers | None (add-ons) | Limited precision | Custom setup |

| Event Tagging | Applause and various non-verbal cues | Not supported | Limited | Not supported |

| Latency | Low for optimized formats | Hardware-dependent | Real-time streaming | Streaming-focused |

Pourquoi choisir Kie.ai pour l’API speech to text d’ElevenLabs

Tarifs avantageux pour l’API speech to text

Kie.ai propose l’API speech to text d’ElevenLabs via un système simple fonctionnant sur un système de crédits. Les développeurs ne paient que ce qu’ils utilisent, ce qui rend les tests, la mise à l’échelle et l’intégration des fonctionnalités de transcription plus économiques. Par rapport aux offres officielles d’ElevenLabs ou à des fournisseurs comme Fal, Kie.ai fournit la même API de transcription vocale de haute qualité à un coût nettement inférieur.

Documentation complète de l’API et support pour les développeurs

L’intégration se fait facilement grâce à la documentation détaillée de l’API ElevenLabs. Kie.ai fournit des exemples clairs, des extraits de code et des guides techniques pour l’API speech to text d’ElevenLabs, pour aider les développeurs à démarrer rapidement. Des canaux de support dédiés facilitent l’onboarding et aident à résoudre les éventuels problèmes.

Innovation : Une infrastructure fiable et évolutive

Kie.ai garantit une disponibilité de 99,9 % et un support de haute concurrence, permettant à l’API de transcription de la parole en texte d’adapter l’API aux besoins des applications individuelles comme des charges de travail d’entreprise. Qu’il s’agisse de traiter de courtes notes vocales ou des transcriptions de réunions à grande échelle, les développeurs peuvent compter sur des performances constantes et fiables.

Comment intégrer l'API STT d'ElevenLabs dans Kie.ai

Étape 1 : Obtenez votre clé API de transcription de la parole en texte

Inscrivez-vous sur Kie.ai pour obtenir votre clé API. Cette clé vous permet d’accéder en toute sécurité à l’API speech to text d’ElevenLabs et d’authentifier vos requêtes lors de l’utilisation de l’API speech to text.

Étape 2 : Créez une tâche de transcription

Envoyez une requête à l'endpoint Task avec le modèle réglé sur "elevenlabs/speech-to-text". Fournissez l'URL du fichier audio et des paramètres optionnels tels que code_langue, événements_audio ou diarize pour adapter l'API de transcription de la parole en texte à vos besoins.

Étape 3 : Récupérez vos transcriptions

Vérifiez le statut de la tâche ou utilisez le callBackUrl pour recevoir automatiquement les résultats de transcription. L'API ElevenLabs Scribe renvoie des sorties JSON structurées pouvant être intégrées dans des applications, des sous-titres ou des processus métier grâce à l'API STT.